製品一覧

- モバイル/ポータブルゲーム機

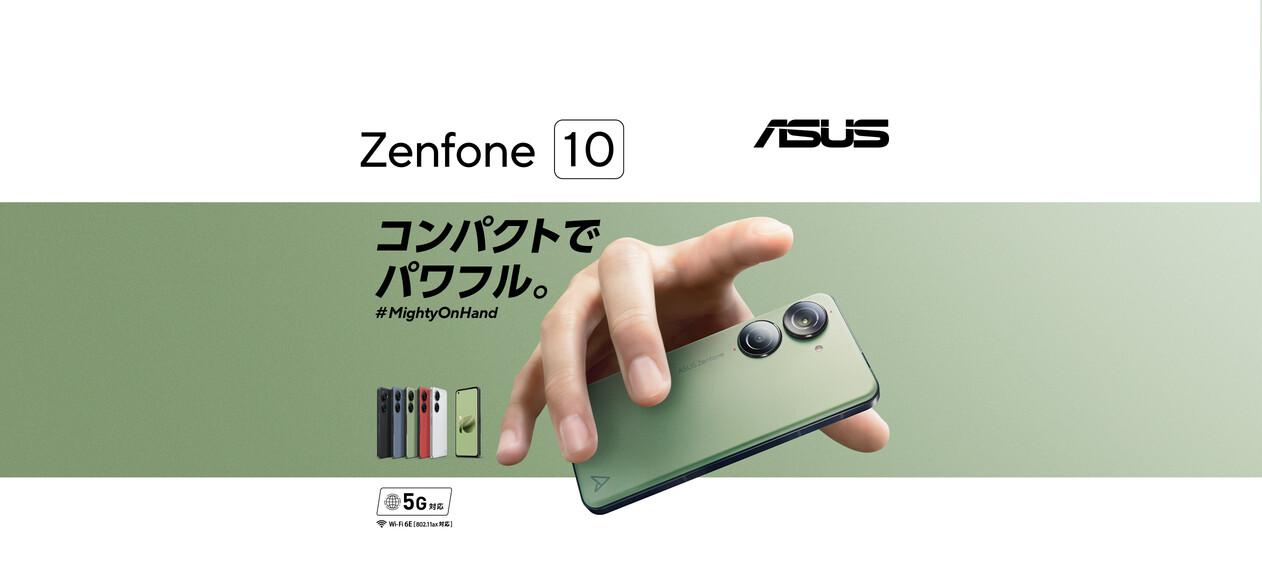

- スマートフォン

- ウェアラブル

- ポータブルゲーム機

- ノートパソコン

- ノートパソコン

- クリエイター向けノートパソコン

- 法人向けノートパソコン

- GIGA School

- ゲーミングノートパソコン

- 周辺機器

- Windows 11

- あんしん保証

- ディスプレイ/デスクトップ

- モニター

- プロジェクター

- 液晶一体型パソコン

- デスクトップパソコン

- Wi-Fiルーター

- メッシュWi-Fiシステム

- Wi-Fi 中継器

- 子機

- 有線ネットワーク

- AIoT & インダストリアルソリューション

- サーバー

- Storages

- 周辺機器

- キーボード

- マウス・マウスパッド

- ヘッドセット・オーディオ

- ストリーミングキット

- PCバッグ・ギア

- スマートフォンケース

- ドック,ドングルとケーブル

- ジンバル

- Display Accessories